SEO ChatGPT & GEO : Ranker dans l’IA en 2026

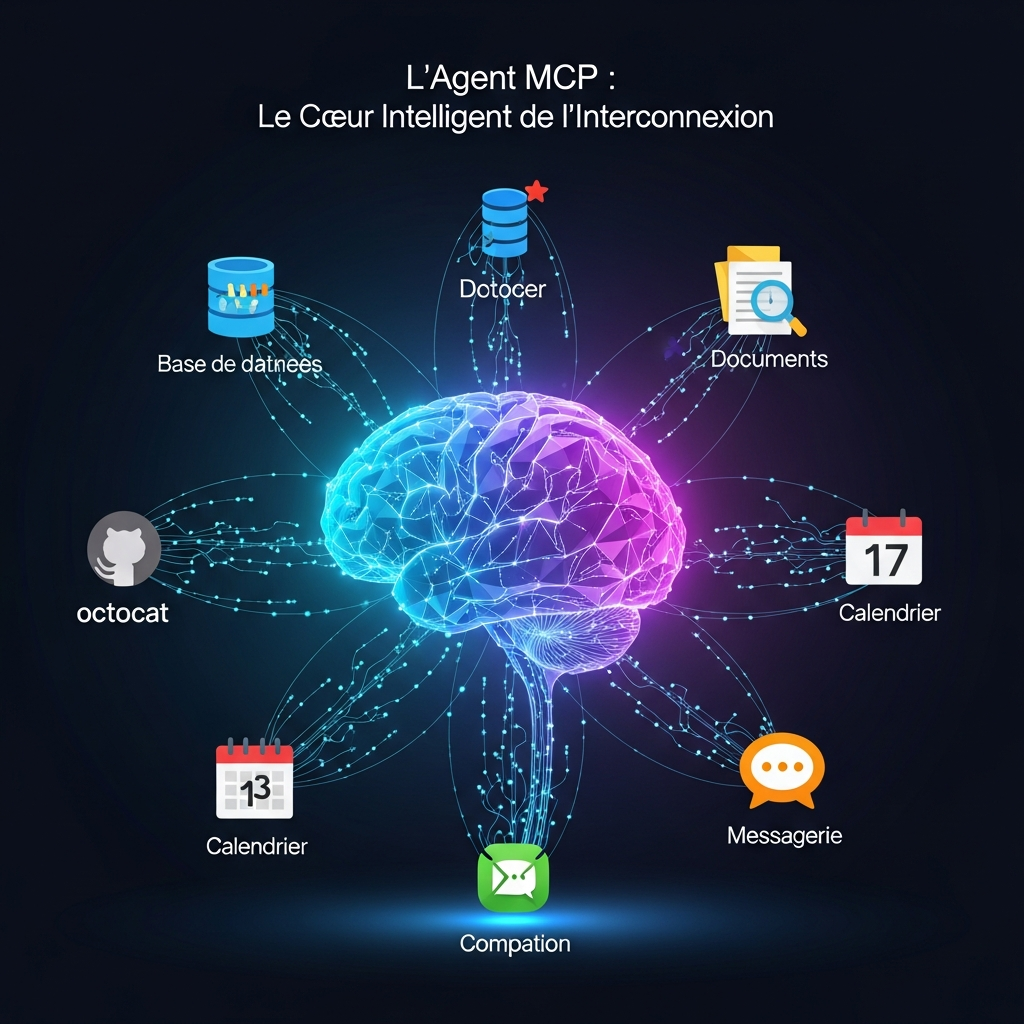

Votre trafic organique stagne malgré un contenu irréprochable ? Vous avez peut-être oublié un détail : en 2026, Google n’est plus le seul arbitre de votre visibilité. ChatGPT Search indexe désormais 200 millions de requêtes hebdomadaires, et votre site n’apparaît nulle part dans ses citations. Pendant que vous optimisez vos balises meta pour Googlebot, OAI-SearchBot visite vos pages sans que vous ne le sachiez. La Citation Authority remplace progressivement le PageRank comme indicateur d’autorité. Bienvenue dans l’ère du GEO (Generative Engine Optimization), où votre robots.txt peut vous coûter 30% de visibilité potentielle si vous ignorez un seul User-Agent. Cette mutation n’est pas théorique. Depuis le lancement officiel de ChatGPT Search en octobre 2024, puis l’arrivée d’Atlas (le navigateur intégré) et des Agents autonomes en 2025, l’écosystème OpenAI structure une alternative complète aux moteurs traditionnels. Mais comment se faire citer par un LLM ? La réponse exige une refonte technique de votre approche SEO. Du SEO au GEO : Comprendre l’écosystème de recherche OpenAI Le paradigme a basculé. Google classe des documents par pertinence, ChatGPT synthétise des réponses à partir de sources primaires. Cette distinction technique modifie radicalement votre stratégie d’optimisation. L’architecture 2026 repose sur trois piliers complémentaires : ChatGPT Search : Le moteur de recherche conversationnel qui génère des réponses enrichies avec citations (ces fameux liens bleus sous les paragraphes). Propulsé par une version distillée de GPT-4o, il interroge l’index Bing et des partenariats médias directs. Atlas : L’environnement de navigation qui permet au modèle de « voir » les pages web en temps réel. Plus qu’un simple crawler, il exécute du JavaScript et interagit avec les interfaces. Les Agents : Ces entités autonomes (nom de code « Operator » en bêta) réalisent des tâches multi-étapes. Ils ne se contentent pas de lire, ils réservent, achètent, comparent. 💡 Conseil d’expert : Contrairement à Google qui privilégie la densité de mots-clés, ChatGPT favorise la densité d’information. Un tableau de données structure vaudra plus qu’un paragraphe de transition élégant. La conséquence pour vous ? Votre contenu doit être « Answer-Ready » : structuré pour être cité, pas juste lu. Checklist Technique : Maîtriser les Crawlers (OAI-SearchBot vs GPTBot) OpenAI déploie trois User-Agents distincts, chacun avec une fonction précise. Confondre leur rôle compromet votre visibilité. Voici la matrice décisionnelle que tout expert SEO doit intégrer : User-Agent Fonction Impact SEO Search Configuration robots.txt Ignoré par l’utilisateur ? OAI-SearchBot Indexation pour ChatGPT Search ✅ Critique Allow: / obligatoire Non GPTBot Entraînement des modèles futurs ❌ Aucun Peut être bloqué Non ChatGPT-User Navigation live (Atlas/Agents) ⚠️ Indirect (actions) Peut ignorer robots.txt Oui (trafic utilisateur) OAI-SearchBot est votre priorité absolue. Sans lui, vous êtes invisible dans les résultats de recherche. Cette configuration autorise l’indexation Search tout en protégeant votre contenu de l’entraînement des modèles. Notez la subtilité : bloquer GPTBot n’affecte pas votre ranking dans ChatGPT Search. Le facteur Bing, souvent sous-estimé, devient déterminant. ChatGPT Search s’appuie massivement sur l’API Bing pour la découverte d’URL. Sans présence dans Bing Webmaster Tools, vous n’existez pas pour OpenAI. Cette dépendance technique explique pourquoi certains sites bien rankés sur Google restent absents des citations ChatGPT : leur sitemap XML n’a jamais été soumis à Bing. ⚠️ Attention : ChatGPT-User, en tant que navigateur piloté par l’utilisateur, peut contourner robots.txt depuis décembre 2025. Pour un contrôle strict, utilisez le blocage IP via firewall (plages vérifiables sur openai.com/searchbot.json). Optimisation de Contenu « Answer-Ready » : Comment nourrir le LLM ? Ranker dans ChatGPT exige une refonte éditoriale. Le modèle ne « lit » pas comme un humain, il parse des structures. Densité d’information : Oubliez le remplissage. Chaque phrase doit contenir un fait vérifiable. Les introductions fleuries (« Dans un monde en constante évolution… ») diluent votre autorité. Privilégiez les données brutes : chiffres, dates, noms propres. Une étude de Rand Fishkin (SparkToro, 2025) montre que les citations OpenAI favorisent les contenus avec au moins 3 métriques quantifiables par section. Structure technique optimale : Listes à puces : Le format préféré du LLM pour l’extraction de faits multiples. Une liste de 5 points structurés bat systématiquement un paragraphe narratif équivalent. Tableaux de données : Facilement parsables, ils augmentent votre Citation Authority. Le modèle peut extraire une cellule spécifique sans reformuler l’ensemble. Citations directes : Encadrez les définitions ou statistiques clés entre guillemets. ChatGPT peut alors les reprendre littéralement avec attribution. Fraîcheur (Data Recency) : Pour les requêtes d’actualité, la date de publication devient le critère n°1. ChatGPT Search privilégie systématiquement les contenus publiés dans les dernières heures pour les sujets « breaking news ». Implémentez correctement les balises <time> et Schema.org dateModified. Les mentions de marque sans lien (Backlinkless mentions) gagnent en importance. L’algorithme d’OpenAI analyse les co-occurrences sémantiques. Être mentionné dans une liste « Top 10 » d’un site d’autorité améliore votre Citation Authority, même sans backlink direct. Cette évolution bouleverse les métriques SEO traditionnelles. Au-delà du Search : Préparer son site pour les Agents et Atlas L’arrivée des Agents autonomes transforme l’accessibilité technique en facteur de ranking. Ces entités doivent « comprendre » votre interface pour exécuter des actions. WAI-ARIA devient un critère SEO. Les balises ARIA, conçues initialement pour les lecteurs d’écran, aident désormais les agents IA à identifier les éléments interactifs. Un bouton « Réserver » correctement balisé (role= »button », aria-label= »Réserver cette chambre ») sera actionnable par un Agent. Sans ces attributs, votre formulaire reste invisible pour l’IA. Les Données Structurées (Schema.org) passent du « bonus » au « prérequis ». Implémentez au minimum : Product : Pour le e-commerce (prix, disponibilité, avis). FAQ : ChatGPT extrait directement les paires question/réponse. Article : Avec datePublished et dateModified à jour. L’équipe d’OpenAI a confirmé en janvier 2026 que les agents Atlas utilisent ces balises pour construire leur graphe de connaissances. Un produit sans Schema.org ne sera pas recommandé par un Agent Shopping. 💡 Conseil d’expert : Testez votre site avec un lecteur d’écran (NVDA ou JAWS). Si un utilisateur malvoyant ne peut pas naviguer facilement, un Agent ChatGPT non plus. Optimisez également vos temps de chargement. Les agents exécutent des parcours multi-pages. Un site lent (>3s) voit son taux d’abandon par Agent exploser, réduisant vos chances de citation dans les réponses finales. FAQ

SEO ChatGPT & GEO : Ranker dans l’IA en 2026 Lire la suite »